过去几年,事件型视觉传感器(EVS)在半导体与人工智能领域持续受到高度关注。与传统 CMOS 图像传感器(CIS)不同,这种仿生视觉器件只感知场景中的动态变化,而非连续采集静态图像。其每个像素独立工作,仅在光照变化超过阈值时触发事件信号,这种架构带来了连续时序感知、数万帧级超高等效帧率、以及超宽动态范围等独特优势。

凭借这些特性,EVS 被视为汽车安全、工业自动化、医疗成像、消费电子等领域的理想方案。但尽管历经多年研究与多次商业化落地,其市场普及度仍不均衡,尤其在消费级市场始终难以规模化放量。

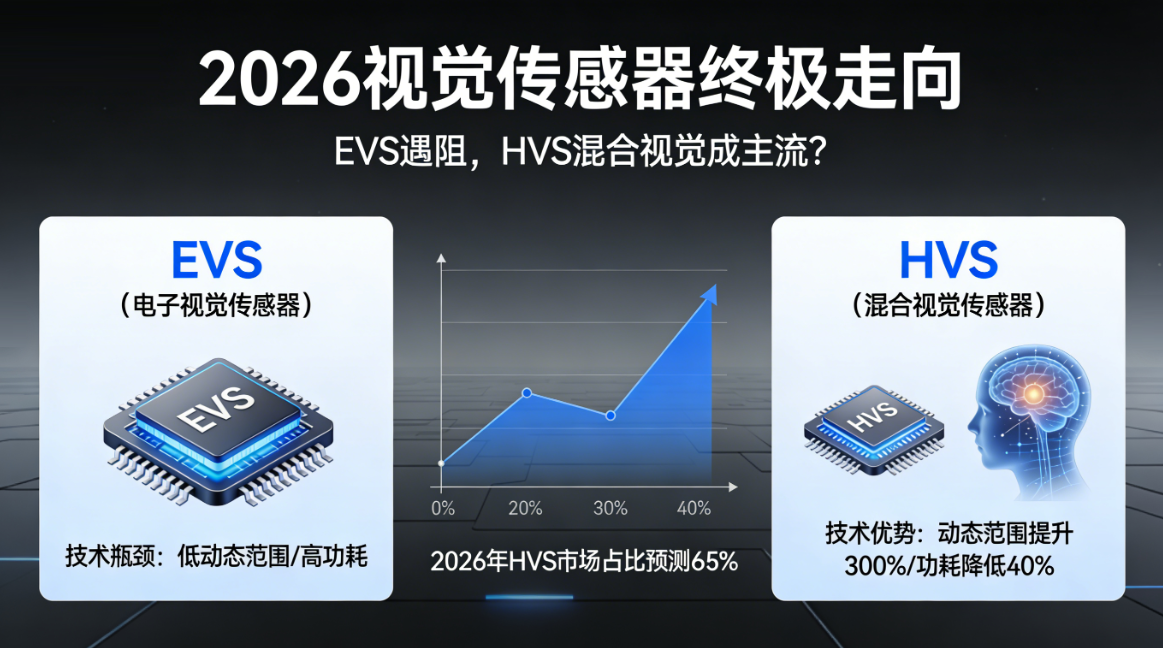

近日,AlpsenTek(锐思智芯)创始人兼 CEO 邓坚,从系统级视角深入解析了 EVS 规模化落地的痛点,并指出混合视觉传感器(HVS)才是更务实、更可行的破局路径。

AI 时代需要对外部世界进行多维、多模态的理解。邓坚表示,以智能驾驶为例,一个稳健的视觉系统理想上需要五大维度信息:二维图像平面、深度信息、颜色 / 光谱数据,以及至关重要的时间与运动信息。这五大维度共同构成了现代机器视觉的基础。

传统图像传感器提供空间细节,ToF 等测距传感器补充深度,光谱传感器拓展色域,但时间与运动信息却难以高效获取。传统视频依赖固定帧率,数据冗余极高,提取有效运动线索需要巨大算力开销。

事件型视觉的逻辑完全不同。 邓坚解释道,它受人类视网膜启发,只将变化编码为稀疏事件信号,直接、高效、连续地捕捉运动信息,是对传统帧成像传感器的完美补充。

自 2019 年成立以来,AlpsenTek 一直致力于将事件感知 + 帧成像两种技术范式融合在单一芯片中。其混合视觉传感器 HVS 实现了像素级融合,并计划未来进一步集成测距、光谱等模态,打造面向下一代 AI 系统的 全栈式视觉传感器。

在此背景下,这场专访围绕 HVS 的技术定位、价值、应用、集成逻辑与产业化前景,展开了五个关键问题的深度探讨。

HVS 混合视觉传感器的核心定位是什么?

HVS 的本质,是在单颗传感器内同时集成传统成像与事件视觉。EVS 虽已被广泛认知,具备低数据量、高响应速度、宽动态范围等优势,但 HVS 的核心差异在于:它首先是一颗图像传感器,而非单纯的事件传感器。

据 AlpsenTek 介绍,HVS 通过在同一像素阵列中集成图像采样电路与事件检测电路,实现了独家像素级融合架构,并依托 iampCOMB、GESP、IN‑PULSE DiADC 等像素内处理技术,以及 TILTech、PixMUX 等时序交织读出方案,支持传统图像模式、事件模式、混合模式三种工作状态。

邓坚强调,HVS 应被视作CIS 的进化升级,而非平行替代技术。在多数场景中,它可作为主成像传感器使用,而非辅助配件。

与纯 EVS 相比,HVS 走的是平衡路线:

纯事件传感器帧率可轻松破万,适合对成本不敏感的超高速场景;

HVS 则在帧率、动态范围、像素尺寸、功耗、数据量、成本之间实现最优权衡。

目前 AlpsenTek 的 HVS 可轻松实现等效 1000fps 帧率 + 120dB 动态范围,同时保持远低于纯事件传感器的成本,更适合大批量消费市场。

邓坚同时指出,传感器集成是行业大趋势:在智能手机中,ToF、光谱等功能已逐步融入主摄。AlpsenTek 的路线同样遵循这一方向 ——事件感知最终会成为图像传感器的一部分,而非独立外挂器件。

从系统层面看,HVS 解决了视觉系统中一个核心痛点:数据配准。运动信息无比重要,但只有 EVS 能高效捕捉;而运动数据最终必须与图像数据在时空坐标内精准映射。HVS 凭借像素级同源,在这一点上具备天然优势。

HVS 能做什么?核心应用场景理论上,所有适合事件相机的场景,都能通过 HVS 实现升级;而 HVS 可输出标准图像的能力,又极大拓宽了落地边界。

在汽车领域,事件传感的高动态、快响应、低延迟、低数据冗余特性,尤其适合光照剧烈变化的车载环境。邓坚将其总结为抢占式感知:传统图像传感器需要完整曝光与解析,系统响应存在延迟;事件传感则能快速提供粗粒度关键信息(如快速移动障碍物),触发后续高精度语义分析,显著提升响应速度、安全性与能效。

在智能手机领域,HVS 可实现高时序分辨率运动捕捉,即使在暗光下依然稳定。运动信息可大幅提升去模糊、HDR、视频帧插值等图像增强效果;在 AI 视频剪辑中,事件信号能在帧间提供连续时序参考,提升流畅度与一致性。

AlpsenTek 已推出面向手机的紧凑型 HVS 方案,可与主摄直接对齐,降低多传感器异构数据的配准复杂度,这也是与头部手机 OEM 深度合作的成果。

从成像全链路看,HVS 贯穿拍摄前、拍摄中、拍摄后:

拍摄前:辅助测光、对焦;

曝光中:连续记录运动与变化;

拍摄后:优化帧配准,支撑高级图像处理。

2023 年,AlpsenTek 推出首款量产 HVS 芯片 APX003(原 ALPIX‑Eiger),目前主要落地两大方向:

高速传感场景:机器人、运动相机等;

边缘 AI 低功耗场景:XR、手机前置、智能家居、交通监控等。

邓坚反复强调:HVS 本质就是一颗 AI 传感器。用高帧率视频训练 AI 系统效率极低,大量无效数据带来巨大存储与算力成本;而事件传感可在传感器端直接完成数据提纯,过滤无效信息,让物理 AI、具身智能实现更高效的实时交互。

为什么一定要做像素级融合?

既然可以采用多传感器组合,为何还要执着于像素级融合?

核心矛盾在于:事件传感器与图像传感器的底层架构天然不匹配。事件传感器基于光强变化做微分触发,图像传感器则基于积分成像,二者采样机制、数据结构、时序逻辑完全不同。

邓坚明确表示:HVS 不是图像传感器 + 事件传感器简单拼贴,而是自带事件功能的新一代图像传感器,像素阵列可与主流 CIS 对标。 AlpsenTek 已实现 1.89μm 像素尺寸 HVS 量产,而部分商用纯事件传感器像素仍大于4μm。

同时他也提醒:并非像素越多越好。事件信息本身稀疏、粗粒度,过高的事件分辨率只会增加数据量与成本,却不会带来等效收益。因此 AlpsenTek 采用图像分辨率与事件分辨率独立配置的策略,可根据场景灵活定制。

像素级融合的核心价值是原生时空对齐。图像与事件数据来自同一像素,配合专用读出电路,空间与时间配准天然完成,省去外部同步与复杂后配准算力开销。而双传感器方案在异构数据、不同帧率、时空对齐上存在先天难题,这也是早期纯事件传感器难以进入消费设备的重要原因。

支持事件数据,需要整套算法框架与数据结构重构,开发成本极高,投资回报率往往不成正比, 邓坚说道。

HVS 何时能实现大众市场规模化?

早期事件传感器厂商的探索,留下了重要启示:独立事件传感器在集成难度、数据处理、产品定位上均存在障碍,多数厂商也缺乏与手机 OEM 的深度协同。

邓坚将这一过程类比 ToF 传感器 —— 从技术出现到手机大规模普及,同样经历了数年培育期。而现在,HVS 的产业化时机已经成熟:

需求侧:AI 应用对高效运动感知、低功耗的需求爆发;

供给侧:HVS 技术成熟,可提供明确 ROI。

HVS 在传感器端完成数据精简,高度契合边缘设备需求,目前已在可穿戴、AIoT、智能交通、安防等领域批量出货。

我们预计 2026–2027 年将是 HVS 快速增长期。 邓坚判断,AlpsenTek 是目前业内唯一实现此类传感器量产的公司,且已完成完整的算法与系统生态搭建。

更关键的是,HVS 可基于标准 CIS 工艺流程制造,无需专用产线,随着需求放量,产能不会成为瓶颈。

HVS 技术与生态成熟度如何?

2025 年 4 月,AlpsenTek 完成 B 轮融资,投资方包括智慧互联产业基金、普信资本、中车时代投资等。在此之前,公司已完成四轮融资,股东阵容包括联想、OPPO、歌尔股份、虹软科技、舜宇光学、中科创星、清科、光远投资等一线产业与财务资本,足见市场对 HVS 路线的长期信心。

从 2019 年成立到 2023 年首款芯片量产,AlpsenTek 攻克了像素集成、干扰抑制、工艺优化、摄像头模组机械限制等一系列工程难题。

除硬件外,公司同样重视软件与系统生态:团队大量人力投入混合传感算法与系统开发,提供传感器 + 开发板 + 参考设计 + SDK + 数据集完整方案。

算法覆盖三层:

面向 2bit 事件数据的硬件优化核心算子;

驱动层模型与 SDK(运动 / 人体检测、姿态 / 手势识别等);

客户自定义应用层框架。

同时,公司还提供专用场景事件数据集,大幅降低客户开发门槛。

AlpsenTek 与全球顶尖学术机构合作,支持计算机视觉顶会与前沿研究,推动多模态感知生态成熟。

HVS 生态是一项长期工程。” 邓坚总结道,“随着更多玩家入局、应用成熟、迭代加速,整个生态将进入正向循环。